Spark Temelleri ve RDD Yapısı

Bir sabah kahvenizin buharı arasından verinin akışını izlerken, yüz binlerce kayıttan anlam çıkarmak yerine sadece birkaç tıklama uzağınızda olduğunuzu düşünün. Bu anı, Büyük veri analizi Apache Spark dünyasına adım atmanın dönüm noktası yapabilirsiniz. Başlangıçta karışık görünen kavramlar, temel bilginizle netleşir ve kısa sürede kendi basit veri işleme senaryolarınızı kurarsınız. Amacınız, veriyi yavaş yavaş parçalayarak neyin nerede olduğunu anlamak ve sonuca güvenle ulaşmaktır. Bu bölümde RDD Yapısı ve basit işlemler üzerinden ilerlerken, nedenlerin peşinden gidecek ve hangi hatalardan kaçınmanız gerektiğini keşfedeceksiniz.

Basit veri işleme için temel kavramlar

İlk adımda aklınızda tutmanız gereken kavramlar basitçe üç başlık altında toplanır. RDD yani dağılmış veri kümesi, parçalar halinde saklanan ve üzerinde hesaplama yapılabilen yapı taşınızdır. Üzerinde yaptığınız transformations ve actions ile hesaplama zincirini kurarsınız. Spark bu zinciri tembel değerlendirme ile işler; önce ne yapılacağı belirlenir, sonra tek seferde gerçekleştirilir. Bu, hatalara karşı dayanıklılığı artırır çünkü tüm adımlar bir yol haritası olarak tutulur ve gerektiğinde yeniden hesaplama kolaylaşır. Ayrıca partitioning verinin hangi düğümlerde hangi parçalara ayrılacağını belirler, performansı doğrudan etkiler. Lineage yani hareketlerin iz sürümü ise hatalı bir durumda yeniden hesaplama için kullanılır. Bu temel kavramlar, küçük bir veri setiyle çalışırken bile neden önemli olduklarını gösterir ve size kontrolü verir. Büyük veri analizi Apache Spark çerçevesinde bu kavramlar, ölçeklenebilirliği ve güvenilirliği birlikte sunar.

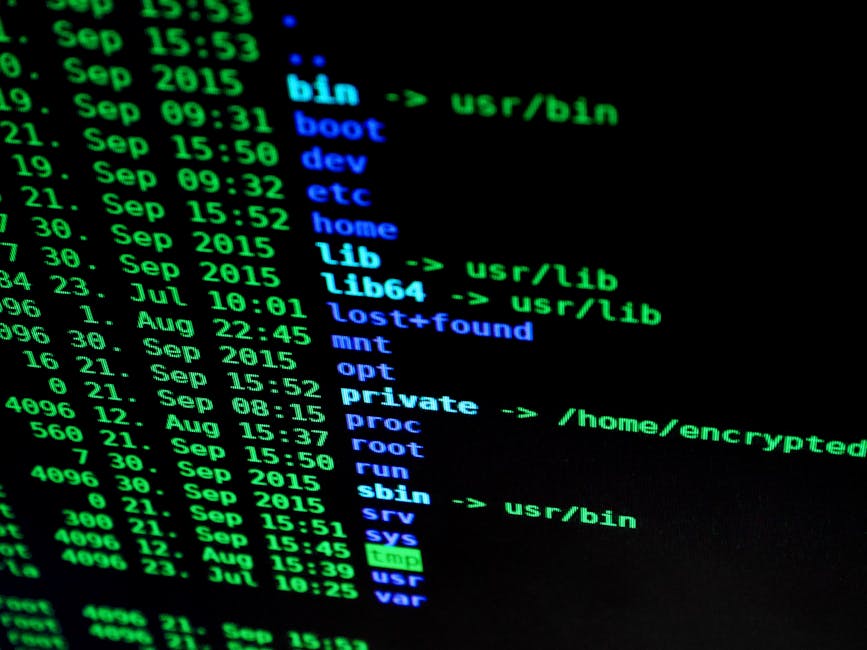

RDD yapısı ve dönüşümler

Her RDD nin bir yol haritası vardır; bu yol haritası, verinin hangi düğümde nasıl işlendiğini gösteren bir zincirdir. Transformations ile yeni bir RDD oluşturursunuz; bu adımlar tembel olarak kaydedilir ve sadece bir action çağrıldığında uygulanır. Örneğin map ile her kaydı dönüştürür, filter ile istenen kriterlere uyanları süzer, flatMap ile çoklu çıktı üretebilirsiniz. Actions ise hesaplamayı başlatır ve sonuçları üretir; collect ile yerel belleğe getirirsiniz, count ile kayıt sayısını alırsınız, saveAsTextFile ile sonuçları uzun vadeli depolamaya atabilirsiniz. Bu yapı, hataya dayanıklılığı artırır çünkü herhangi bir adımın yeniden hesaplanması gerektiğinde lineage üzerinden yeniden yürütülebilir. Basit bir senaryo düşünün; web günlükleri üzerinde hatalı bir satırı atlamak istediğinizde, önce dönüşümlerle temizler, sonra eylem ile sonuçları elde edersiniz. Büyük veri analizi Apache Spark bağlamında bu yaklaşım, küçük denemeden büyük ölçekli üretime sorunsuz geçiş sağlar.

Basit veri işleme için temel adımlar

- Veriyi RDD olarak oluşturun: Veriyi paralel olarak bölüştürmek için parallelize veya dosya tabanlı yüklemeyi kullanırsınız.

- Transformations ile veriyi dönüştürün: map, filter, flatMap gibi işlemlerle veriyi istediğiniz formata getirirsiniz.

- Bir eylem ile sonucu hesaplayın: collect veya saveAsTextFile gibi adımlar hesaplamayı tetikler.

- Sonuçları inceleyin ve gerekirse tekrarlayın: İlk denemede sonuçlar beklediğiniz gibi çıkmazsa adımları inceleyip ayarlayın.

- Birlikte çalışan parça sayısını ayarlamak performansı artırır ancak çok küçük parçalarda aşırı iletişim maliyeti ortaya çıkabilir.

- Hataları erken fark etmek için küçük örnekler üzerinde test edin; hatayı büyük kümelerde görmezsiniz.

- Gereksiz veri kopyalamadan kaçının veriyi mümkün olduğunca local olarak işlemeye çalışın.

Bu basit akış, Büyük veri analizi Apache Spark ile hemen uygulanabilir ve başlangıçta karşılaşılan karmaşa yerine net bir yol haritası sunar. Sonraki aşamada pratikte bu adımları nasıl kafanızda dönüştüreceğinizi göreceksiniz.

Kapanış ve sonraki adımlar

Özetle, basit veri işleme için temel kavramlar size güven verir: RDD nin yapısı, dönüşümler, eylemler ve tembel hesaplama. Bu unsurlar olmadan Spark üzerinde anlamlı sonuçlar elde etmek güçleşir. Şimdi ne yapmalı diye sorarsanız: önce küçük bir veri setiyle deneyin, dönüşümleri adım adım kurun ve eylem ile sonuçları görün. Hata çıktısını analiz edin, ardından adımları optimize edin. Bir sonraki adımda bu kavramları DataFrame ve Spark SQL ile genişleterek daha yüksek düzeyde soyutlama kullanmaya başlayabilirsiniz. Bu yolculukta sabır ve pratik, sizin için nihai başarıyı getirir. Basit adımlarla başlayıp, küçük zaferlerle güveninizi büyütün ve ilerlemeye devam edin.

DataFrame ve SQL ile Analiz

Bir sabah, yüzlerce günlük satış kaydıyla çalışırken ekranınızda hızlı sonuçlar yerine beklemenin eziyetini mi hissediyorsunuz? Yapısal veriyi hızlı sorgulama bir lütuf değil, işe yarayan bir gerekliliktir. Büyük veri analizi Apache Spark ile DataFrame ve SQL kullanırken veriyi önce sorgulanabilir bir tablo olarak görmek, kararlarınız için güvenilir sonuçlar elde etmenin anahtarıdır.

Günlük müşteri işlemleri, stok hareketleri veya sensör verileriyle dolu bir tabloda, hızlı filtreler ve hızlı gruplamalar söz konusu olduğunda yapısal veriyi etkili şekilde sorgulamak kritik hale gelir. DataFrame API ve Spark SQL ile sorgular Catalyst optimizatörü tarafından otomatik olarak iyileştirilir; tek bir filtre işlemi bile uçtan uca hızlı yürütülebilir. Yapısal veriyi hızlı sorgulama, sadece hızlı cevap almak değildir; hangi alanın gerçekten kritik olduğuna odaklanmanıza yardımcı olur.

Hızlı sorgulama için temel yaklaşımlar

Yaygın hatalar arasında tek bir büyük tabloya tüm veriyi yüklemek, çok sayıda UDF kullanmak ve gereksiz geçici görünümler oluşturmaktır. Bunları aşmak için veriyi bölün, gerekli sütunları seçin, filtreleri erken uygulayın ve sık kullanılan sonuçları cache edin. SQL ile DataFrame'leri birleştirmek ekipler arası iletişimi güçlendirir ve optimize edilmiş yollar sunar.

- Veri kaynağını DataFrame olarak içe aktarın ve gerekli sütunları seçin.

- Gereksiz dönüşümleri azaltın ve filtreleri erken uygulayın.

- Cache ile sık kullanılan ara sonuçları saklayın.

- Spark SQL ile geçici görünüm oluşturarak sorguları SQL ile yeniden kullanın.

Sonuç olarak hızlı ve güvenilir bir temel elde edersiniz: Yapısal veriyi hızlı sorgulama becerinizi güçlendirmek için bugünden başlayın.

Dağıtık İşlem ve Bellek Yönetimi

Bir veri akışının ortasında bellek taşması mı yaşıyorsunuz? Büyük veri analizi Apache Spark ekosisteminde her saniye büyüyen veriyi hızla işlemek, doğru bellek yönetimi olmadan bir kabusa dönüşebilir. Dağıtık işlem, binlerce görevin paralel olarak çalışması demektir; bu da her bir düğümün sınırlı bellekyle nasıl başa çıktığına bağlıdır. Bu bölümde, işlemci gücünü ve hafızayı uyumlu bir şekilde kullanmanın yollarını keşfedeceğiz. Amacınız, darboğazları öngörmek, bellek israfını azaltmak ve aynı anda daha fazla veri üzerinde güvenilir sonuçlar elde etmek olsun. Unutmayın ki bellek yönetimi sadece teknik bir ayarlama değildir; doğru stratejiyle hataların önüne geçer, maliyetleri düşürür ve güvenilirliğin temelini oluşturur. Şimdi adım adım, pratik ve uygulanabilir yaklaşımlara geçelim.

Dağıtık İşlemin Temelleri ve Bellek Yönetiminin Dinamikleri

Dağıtık işlem ortamında her görev, birden çok executor üzerinde çalışır ve bellek paylaşımıyla yarışlar doğabilir. Spark çalışma zamanı JVM üzerinde çalışır ve bellek hem Execution hem de Storage alanı için paylaştırılır. Büyük veri analizi Apache Spark performansını etkileyen ana unsurlar, bellek tahsisi, serileştirme ve bellekten diske taşma davranışıdır. Executor bellek miktarı, bellek paylaşım oranı ve bellek içindeki verinin nerede saklandığı doğrudan görevin başarısını belirler. Unutmayın ki bellek, işlemlerin hızını belirleyen motor gibidir; yanlış yapılandırma, sık GC durmalarına ve spillere neden olur. Bu bölümü takip eden adımlarda, bellek mimarisinin nasıl optimize edildiğini göreceksiniz; amaç her görev için yeterli alan sağlarken aşırı tahsisten kaçınmaktır. Kritik noktalar: bellek ve hesaplama dengesi, serileştirme maliyeti ve bellek kullanımının dinamik olarak ölçeklenmesi.

Kaynakları verimli kullanma stratejileri

Kaynakları verimli kullanmak için net bir planınız olmalı. Aşağıda uygulanabilir stratejiler ve nedenleriyle birlikte bulacaksınız.

- Gereksiz veri tekrarlamasını azaltın. Veriyi gerektiği kadar saklayın, sık kullanılan ara sonuçları bellek içinde tutun ve gereksiz lokal kopyaları temizleyin.

- Serileştirme ve bellek azaltma. Kryo serileştirme kullanımı ile Java serileştirmeye göre vazgeçilemeyen maliyetleri düşürün; bu, bellek basıncını azaltır ve daha büyük veri setleriyle çalışmayı kolaylaştırır.

- Off-heap bellek kullanımı. Büyük veri analizi Apache Spark sırasında bazı yükler için off-heap bellek kullanımı GC yükünü azaltır ve öngörülebilir performans sağlar. Ancak dikkatli yönetilmeli ve uygun ayarlarla şirket içi sınırlar korunmalıdır.

- Bellek yarı-ölçekli planlama. spark.memory.fraction ve spark.memory.storageFraction ayarları ile hesaplanan bellek dilimlerini dengede tutun; aşırı depo önceliğiyle hesaplama daraltılabilir, tersi durumda ise bellek tükenmesi görülebilir.

- Cache ve persist stratejileri. Hangi veri kümesini hangi seviyede cache edeceğinize karar verin; sık tekrarlanan kullanımlar için disk yerine bellek içi cache avantajlıdır, ancak bellek sınırlıysa stratejik seçim yapın.

- Dengeleme ve karma (data skew). Büyük veri setlerinde anahtar uçlığına dair bölümlendirme ve salting gibi tekniklerle veri dağılımını dengeleyin; bu, düğüm başına bellek yoğunluğu dengesini korur.

- Broadcast ve join stratejileri. Küçük tablolar için broadcast join kullanımı ağ trafiğini azaltır ve belleğe aşırı yüklenmeyi engeller.

Bu stratejilerle bellek baskısını azaltırken iş yükünüzü güvenilir biçimde ölçeklendirebilirsiniz. Hipotez olarak düşünün: doğru kombinasyonla bellek maliyetlerini düşürürken işlem hızı artabilir. Büyük veri analizi Apache Spark bağlamında bu denge, maliyetlerle performans arasında kritik bir seçim değildir; doğru planlama ile her ikisini de optimize etmek mümkün olur.

Gerçek Dünya Senaryoları ve Çözümler

Bir perakende müşterisinin günlük satış analizinde yüz milyonlarca olay işleniyor. Büyük veri analizi Apache Spark altyapısı, yoğun anlık akışlarda bellek toleransını zorlayınca, işler yavaşlıyor ve zamanında raporlama riske giriyordu. Çözüm, ilk olarak bellek yönetimini sadeleştirmek oldu: seri işlemlerde Kryo serileştirme, off-heap bellek kullanımı ve spark.memory.storageFraction ayarlarıyla bellek payını akıllı biçimde ayırdık. Sonuçta, sık kullanılan sipariş verileri RAM üzerinde tutulurken, nadiren erişilen geçmiş veriler diskte tutuldu ve spill oranı dramatik şekilde azaldı. Bu süreçte veri dağılımı da önemliydi; müşteri segmentlerine göre uç değerler olan satış verisinin skew olduğunu fark ettik. Ağırlıklı olarak kararlı bölümlere odaklanarak yük dengesini sağladık. Bu yaklaşım, geri dönüştürülmüş bellek ile daha hızlı yanıtlar ve daha düşük maliyet anlamına geldi. Spark ile çalışırken bu tür kararlı denge, performansı ve maliyeti aynı anda göz önüne alarak ilerlemek demektir.

Sık Yapılan Hatalar ve Doğru Yaklaşımlar

En sık gördüğümüz hatalar bellek yönetimini sonradan düşünmektir. Aşırı caching, yanlış bellek bölütü ve serileştirme olmadan büyük veri setlerini çalıştırmak hızlı bir bellek israfı doğurur. Ayrıca spark.dynamicAllocation gibi özellikler uygun şekilde devreye alınmazsa kaynaklar altında kalabilir ya da aşırı bellek kullanımı yaşayabilir. Doğru yaklaşım, planlama aşamasında hangi verinin ne kadar süreyle saklanacağını belirlemek, gereksiz offseason işlemlerini minimize etmek ve düğüm arasındaki bellek dengesini sürekli izlemektir. What-if senaryoları ile ilerlemek, olası darbeleri öngörmeye yardımcı olur: örneğin ani artan yükte hangi ayarların en hızlı şekilde güvenilir sonuçlar sağlayacağını öngörmek gibi. Bu bölümde paylaştığım adımlar, pratikte uygulanabilir ve hızlı sonuç veren stratejilerdir. Şimdi hızlı bir eylem planı ile devam edelim.

- Mevcut bellek kullanımını izleyin ve temel metrikleri kaydedin: spill percentage, GC süresi, bellek kullanım oranı.

- Gereken ayarları kademeli olarak optimize edin: Kryo serileştirme, off-heap etkinliği, memory fraction dengesi.

- Join ve cache stratejilerini yeniden tasarlayın: küçük tablolar için broadcast, büyük tablolar için bölümlendirme ve uygun cache seviyeleri.

- Data skew için özel önlemler alın: uç değerleri dengeli bölümlere taşıyacak teknikler uygulayın.

- Dağıtık işlem ve bellek performansını periyodik olarak test edin ve ayarları yeniden dengeleyin.

Bu adımlar, bellek sorunlarını öngörme ve hızla iyileştirme imkanı verir. Kısacası hedef, kaynakları akıllıca kullanarak güvenilir, hızlı ve maliyet etkin çözümler üretmektir. Not edin: her proje farklıdır; bu yüzden izleyin, deneyin ve ihtiyaca göre uyarlayın.

Gelişmiş Analitik ve Uygulama

Bir Başlangıç Anı: İçindeki Hızlı Kararlar

Bir sabah masaüstünüzde yüz binlerce işlem kaydı, yüzlerce akış segmanı ve yüzleşmek zorunda olduğunuz bir karar var. Veriler akıyor, fakat siz hâlâ hangi müşterinin kayıp olduğunu, hangi ürüne ilgi göstereceğini veya hangi dolandırıcılık mesajının gerçek olduğunu tahmin etmek için beklemek zorunda kalıyorsunuz. Bu duyguyu daha önce de yaşadınız: model hazır, veri akışı yavaş, sonuçlar gecikiyor. İşte bu anda Büyük veri analizi Apache Spark devreye girer ve sizi yalnız bırakmaz. Spark ile veriyi önce temizler, sonra ölçekli özelliklerle zenginleştirir, ardından makine öğrenimi modellerini parçalanmış veride eğitir ve sonuçları gerçek zamanlı akışa adapte eder. Bu hikaye, teoriden pratikte güvenilir kararlar almaya geçişin nasıl mümkün olduğunu anlatır. Belirsizliklerle dolu bir dünyada umut, doğru mimari ve akıllı entegrasyonla kazanılabilir olduğunu gösterir. Siz de kendi projenizde verileri sadece toplamakla kalmayıp, anlamlı hareketlere dönüştürmek istiyorsunuz. Bu yüzden başlıyoruz.

Makine Öğrenimi Entegrasyonu ve Pipelines

Birlikte çalışabilir bir akış inşa etmek, tek bir model yerine birden çok aşamadan oluşan bir yol haritası gerektirir. Bu yolculukta Büyük veri analizi Apache Spark içindeki MLlib ve DataFrame tabanlı pipeline'lar en güçlü iş ortağınızdır. İlk adım veri hazırlama: temiz ve normalleştirilmiş veriler, eksik değerlerin dönüştürülmesi ve hiparparametreler için uygun aralıkların belirlenmesi. Ardından özellik mühendisliği adımı gelir. Zaman pencereleri, kayıp değerlerin imputationı, kullanıcı davranışlarının agregasyonu gibi işlemlerle modele daha zengin girdiler sağlarsınız. Model eğitimi için dağıtık hesaplama kullanılır; bu sayede yüz milyonlarca kayıttan öğrenilen kalıplar kısa sürede çıkarılabilir. Pipeline kavramı, veri dönüşümlerini ve modelleri tek bir güvenli yol üzerinde birleştirir ve sürümlenebilir bir süreç oluşturur. Bu, hem tekrarlanabilirlik hem de izlenebilirlik sağlar. Unutmayın, başarılı entegrasyon sadece nasıl yapılacağını değil neden yapılacağını da içerir: modellerin karar verdiği her anı, verinin hangi özelliğinden beslendiğini bilmek gerekir.

- Veri hazırlama ve temizleme adımları belirli bir standartta otomatikleşir.

- Özellik mühendisliği ile modelin performansı artırılır ve genelleştirme güçlendirilir.

- Dağıtık eğitim ile büyük veri setlerinden hızlı sonuçlar elde edilir.

- Modeli üretime alırken izleme ve geri besleme mekanizmaları kurulur.

Ölçeklendirme ve Dağıtım Stratejileri

Gerçek dünyada bir modelin tek seferlik başarısı değil, zaman içindeki istikrarı önemlidir. Ölçeklendirme, yalnızca hesaplama gücünü artırmak değildir; aynı zamanda veri akışının çoğalmasına uyum sağlamak ve servis seviyelerini korumaktır. Büyük veri analizi Apache Spark ile hem toplu iş yüklerini hem de akış tabanlı işlemleri tek bir çatıda yönetebilirsiniz. Dağıtık öğrenme, model güncellemeleri ve skorlamayı bir araya getirir; bu da canlı sistemlerde anlık fark yaratmayı mümkün kılar. Ancak başarı, doğru stratejiyi seçmekten geçer. Küçük bir ekip için batch ile starting point uygun olabilirken, hızlı geri bildirim isteyen uygulamalar için mikro servisler ve gerçek zamanlı inference gereklidir. Ayrıca veri skew, bellek kullanımı ve iletişim maliyetleri gibi sorunları önden düşünmek gerekir. Uygulanan yaklaşım ne olursa olsun, izleme, sürüm yönetimi ve otomatik yeniden eğitim planını asla ihmal etmeyin.

- Açık uçlu modeller yerine üretim odaklı basit ve tutarlı yaklaşım tercih edin.

- Gerçek zamanlı akış ihtiyacı olan durumlarda Stream Processing ile gecikmeyi azaltın.

- Veri yüküne göre kaynakları ölçeklendirin ve maliyetleri izleyin.

- Model driftünü yakalamak için periyodik retraining planı oluşturun.

Uygulama Yol Haritası ve Sonuç

Şimdi adım adım bir yol haritası ile ilerleyelim. İlk olarak hedefleri netleştirin: hangi kararlar hangi hızda gereklidir ve hangi metrikler başarıyı tanımlar? Ardından veri entegrasyonunu sağlayın; veri kalitesi ve güvenlik kontrollerini kurun. Üçüncü olarak bir MVP inşa edin: Büyük veri analizi Apache Spark üzerinde basit bir pipeline ile bir pilot amaçlı model eğitin ve sonuçları gerçek kullanıcılarla test edin. Dördüncü adımda üretime alınan modeli izleyin ve performansı sürekli ölçün; drift, gecikme ve maliyet başlıca göstergeler olsun. Beşinci olarak geri besleme ile retraining planı oluşturun ve model güncellemelerini otomatik hale getirin. Bu süreçte contrarian bir bakış açısı da faydalıdır: mutlak doğruluk peşinde koşarken, pratikte güvenilirlik ve ölçeklenebilirlik en değerli şeydir. Başarı, başlangıçta beklenenden daha sade bir mimariden gelebilir.

- Hedefleri net olarak yazın ve paydaşlarla paylaşın.

- Veri entegrasyonu ve kalite kontrollerini kurun.

- Bir MVP ile uç uçma testlerini gerçekleştirin.

- Üretime alma ve izleme süreçlerini otomatikleştirin.

- Retraining ve sürüm yönetimini planlayın.

Bu yolculukta hatalar da öğrenme fırsatıdır. Büyük veri analizi Apache Spark ile makine öğrenimini entegre etmek ve ölçeklendirmek, sadece teknik bir seçim değil aynı zamanda iş kararlarınızı somut ve güvenilir kılar. Şu an bir sonraki adımı hangi alanda atmak istiyorsunuz? Hemen bir pilot proje seçin, hedefinizi belirleyin ve ekip olarak ilerlemeye başlayın. Başarı, adım adım atılan kararlı hareketlerde saklıdır.