LLM Fine-Tuning Nedir?

LLM fine-tuning (ince ayar), önceden eğitilmiş büyük dil modellerinin belirli bir görev veya alan için ek veri üzerinde yeniden eğitilmesi sürecidir. GPT, LLaMA, Mistral gibi genel amaçlı modeller, fine-tuning ile hukuk, tıp, finans veya müşteri hizmetleri gibi spesifik alanlarda uzmanlaştırılabilir.

Fine-tuning, sıfırdan model eğitmeye kıyasla çok daha az veri ve hesaplama kaynağı gerektirdiği için hem ekonomik hem de pratik bir yaklaşımdır. Transfer öğrenme prensibine dayanan bu yöntem, modelin genel dil bilgisini korurken alan spesifik yetenekler kazanmasını sağlar.

Fine-Tuning Türleri

1. Tam Fine-Tuning (Full Fine-Tuning)

Modeldeki tüm parametrelerin güncellenmesi yaklaşımıdır. En yüksek performansı sunsa da büyük hesaplama kaynağı gerektirir ve felaket unutma (catastrophic forgetting) riski taşır.

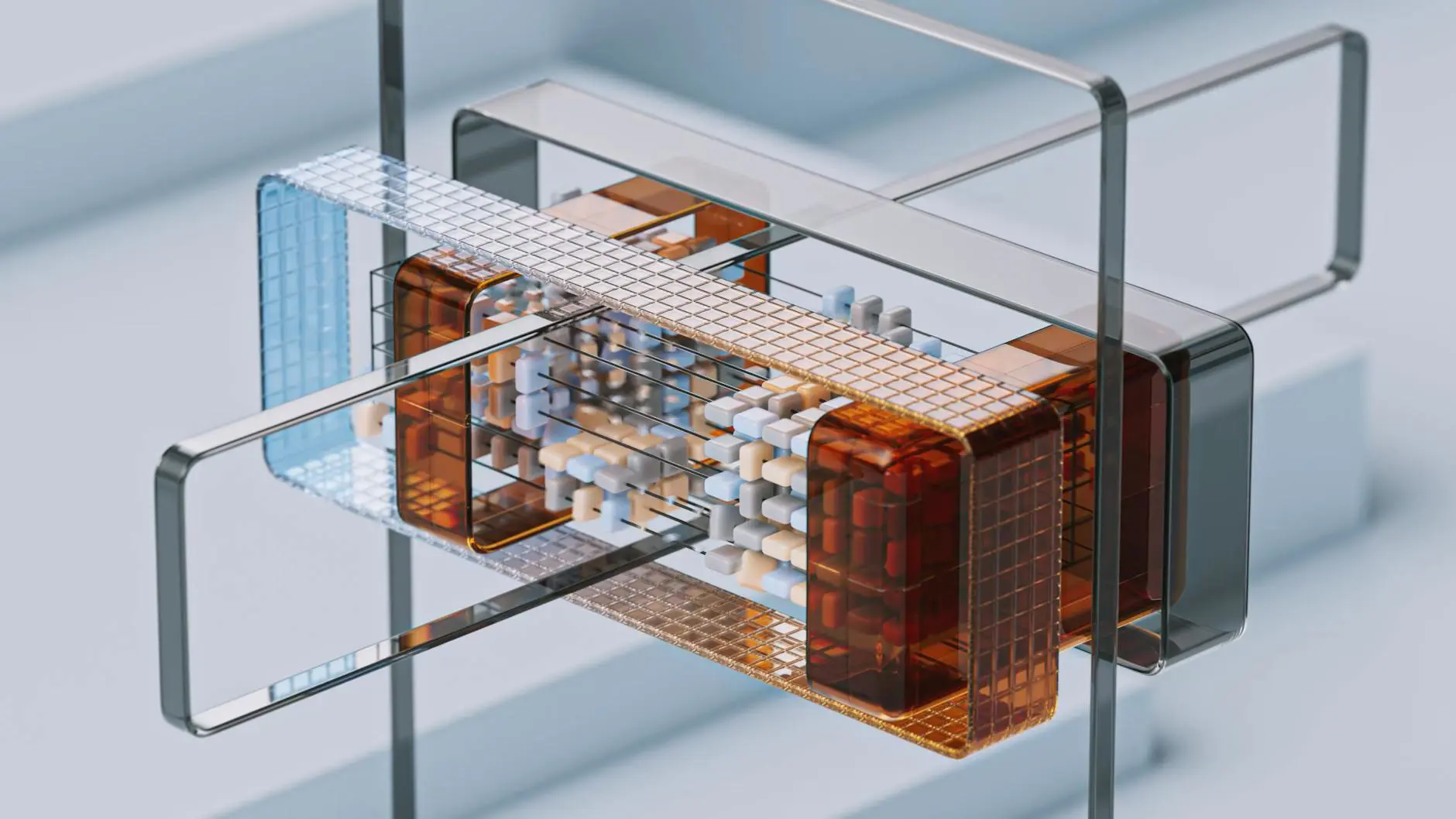

2. Parametre Verimli Fine-Tuning (PEFT)

Modelin yalnızca küçük bir bölümünün güncellenmesiyle etkili sonuçlar elde etmeyi hedefler:

- LoRA (Low-Rank Adaptation): Düşük boyutlu matris ayrıştırma ile parametre verimliliği

- QLoRA: Niceleme ile birleştirilmiş LoRA, bellek kullanımını minimize eder

- Prefix Tuning: Sanal ön eklerin eğitilmesi

- Adapter Layers: Mevcut katmanlar arasına küçük adaptör modülleri eklenmesi

3. Instruction Tuning

Modelin talimat-cevap formatındaki veri setleriyle eğitilerek komutları daha iyi anlaması ve takip etmesi sağlanır.

4. RLHF (İnsan Geri Bildirimli Takviye Öğrenme)

İnsan değerlendiricilerin geri bildirimleri kullanılarak modelin çıktı kalitesi iyileştirilir. ChatGPT ve Claude gibi modellerin geliştirilmesinde kritik bir rol oynamıştır.

Fine-Tuning Süreci

| Aşama | İşlem | Araç |

|---|---|---|

| Veri Hazırlama | Etiketleme, temizleme, formatla | Label Studio, Argilla |

| Model Seçimi | Temel model belirleme | HuggingFace Hub |

| Eğitim | Fine-tuning çalıştırma | HuggingFace Transformers, Axolotl |

| Değerlendirme | Performans ölçümü | LM Harness, HELM |

| Dağıtım | Model servisi | vLLM, TGI, Ollama |

Veri Seti Hazırlama

Fine-tuning'in başarısı büyük ölçüde veri setinin kalitesine bağlıdır:

- Veri Toplama: Alan spesifik metin verileri, soru-cevap çiftleri veya talimat-yanıt setleri

- Veri Temizleme: Gürültülü, tekrarlayan ve düşük kaliteli örneklerin filtrelenmesi

- Format Standardizasyonu: Modelin beklediği giriş formatına dönüştürme (instruction, input, output)

- Veri Dengesi: Sınıflar arası denge ve çeşitliliğin sağlanması

Hiperparametre Optimizasyonu

Fine-tuning başarısını etkileyen kritik hiperparametreler:

- Öğrenme Hızı (Learning Rate): Genellikle 1e-5 ile 5e-5 arasında, düşük değerler tercih edilir

- Epoch Sayısı: 2-5 epoch genellikle yeterlidir, fazlası aşırı öğrenmeye neden olabilir

- Batch Size: GPU belleğiyle sınırlı, gradient accumulation ile artırılabilir

- LoRA Rank: 8-64 arasında, görev karmaşıklığına göre ayarlanır

- Warmup Adımları: Öğrenme hızının kademeli artışı için

Fine-Tuning vs. Prompt Engineering vs. RAG

- Prompt Engineering: Model değiştirilmez, yalnızca giriş metni optimize edilir. Hızlı ve düşük maliyetli

- RAG (Retrieval-Augmented Generation): Dış bilgi kaynakları modele bağlanır. Güncel bilgi erişimi sağlar

- Fine-Tuning: Model davranışı köklü olarak değiştirilir. Spesifik görevlerde en yüksek performans

Ekolsoft ile LLM Özelleştirme

Ekolsoft, işletmelerin kendi verilerine ve ihtiyaçlarına göre özelleştirilmiş dil modelleri geliştirmesine yardımcı olmaktadır. LoRA ve QLoRA gibi verimli fine-tuning teknikleri kullanan Ekolsoft, Türkçe dil desteği ile donatılmış özel LLM çözümleri sunmaktadır.

Fine-tuning, genel amaçlı bir LLM'yi kurumsal bir uzmana dönüştürmenin en etkili yoludur. Doğru veri, doğru teknik ve doğru değerlendirme metrikleri ile etkileyici sonuçlar elde edilebilir.

Sonuç

LLM fine-tuning, yapay zeka çağının en kritik becerilerinden biridir. LoRA ve QLoRA gibi parametre verimli yöntemler sayesinde, sınırlı kaynaklarla bile güçlü özelleştirilmiş modeller oluşturmak mümkündür. İşletmeler, fine-tuning stratejilerini doğru belirleyerek yapay zeka yatırımlarından maksimum değer elde edebilir.