Blog

Yapay Zeka ve Veri Bilimi

Yapay zeka, bilgisayar sistemlerinin insan benzeri zekâ sergilemesini sağlayan bir alandır. Temel kavramlar arasında makine öğrenimi, derin öğrenme ve doğal dil işleme yer alır. Veri bilimi, verilerin toplanması ve analiz edilmesi süreci ile bu alandaki uygulamalar için kritik bir temel oluşturur. Yapay zeka ve veri bilimi, birlikte çalışarak karmaşık problemleri çözme potansiyeline sahiptir. Uygulama örnekleri sağlık, eğitim ve finans sektörlerinde görülmektedir. Veri analizi yöntemleri, verilerin anlamlı bilgilere dönüştürülmesinde önemli bir rol oynar. Makine öğrenimi, veri seti hazırlama süreçleri ile bütünleşerek etkili sonuçlar elde edilmesine olanak verir. Derin öğrenme, yapay sinir ağlarını kullanarak karmaşık verilere dair sonuçlar çıkarılmasını sağlar. Bununla birlikte, veri güvenliği ve etik sorunlar gibi önemli konular da gündeme gelmektedir. Gelecekte, otomasyon ve kişiselleştirilmiş deneyimler gibi trendler, bireyler ve şirketler için fırsatlar sunacaktır. Yapay zeka ve veri bilimi kariyer olanakları, bu alanlarda uzmanlaşmak isteyenler için birçok fırsat sunmaktadır.

Yapay Zeka Raporları

Yapay zeka, günümüzde birçok sektörde devrim yaratan bir teknoloji olarak, Yapay Zeka Raporları'nın önemini artırmıştır. Bu raporlar, işletmeler ve araştırmacılar için kritik bilgiler sunarak stratejik planlamalarına yardımcı olur. 2023 yılında yapay zeka trendleri, kullanıcı deneyimlerini iyileştiren çözümler ve veri güvenliği konularında önemli gelişmeleri beraberinde getirmiştir. Ayrıca, yapay zeka uygulamalarının etik boyutları ve mahremiyet üzerindeki etkileri de dikkate alınmalıdır. Yapay Zeka Raporları'nın oluşturulması, veri toplama, temizleme ve analizi gibi aşamalardan geçerken belirli araçlar kullanılarak gerçekleştirilir. Bu raporların doğru yorumlanması ve güvenilir verilerle desteklenmesi, işletmelere rekabet avantajı sağlar. Gelecekte, Yapay Zeka Raporları'nın daha kapsamlı ve ulaşılabilir olması beklenirken, sektörel bazda da önemli değişimler yaşanacaktır. Hatalı raporların önüne geçmek için ise veri kalitesi, rapor amacının netliği ve uygun analiz yöntemleri kullanımı gibi unsurlara dikkat edilmelidir.

Dp ve Sp Arasındaki Dönüşüm Süreci

Dinamik Programlama (DP) ve Sıradışı Programlama (SP), bilgisayar bilimlerinde ve yazılım geliştirmede farklı problem çözme yaklaşımlarını temsil eder. DP, tekrar eden alt problemleri daha küçük parçalara bölerek sistematik bir şekilde çözmeyi amaçlarken, SP, yaratıcı ve alışılmışın dışında çözümler üretmeyi teşvik eder. DP, genellikle daha basit yapısıyla hız ve verimlilik sağlarken, SP, büyük ve karmaşık projelerde daha organize bir geliştirme süreci sunar. Dönüşüm süreci, mevcut durumu analiz etme, strateji geliştirme, uygulama ve sonuç analizi aşamalarını içerir. DP, yaratıcı endüstrilerde ve mühendislik projelerinde sıklıkla kullanılırken, SP daha çok yönetim ve organizasyon alanında tercih edilir. Dönüşüm sürecinde, ekip iletişimi ve geri bildirim kültürü, başarı için kritik unsurlardır. Gerçek hayatta başarılı dönüşüm örnekleri, bireylerin zorluklar karşısında pes etmemesi gerektiğini vurgulamaktadır. Gelecekte, dönüşüm süreçleri toplumlar üzerinde kalıcı etkiler yaratacak, ancak karşılaşılabilecek zorluklara da dikkat edilmesi gerekecektir.

Sıralı Dizilerin Büyük Veri Uygulamalarındaki Rolü

Sıralı diziler, belirli bir sıra veya düzen içerisinde yer alan ve genellikle zaman serileri gibi dinamik verilerden oluşan yapılardır. Büyük veri uygulamalarında kritik bir rol oynayan bu diziler, verilerin analiz edilmesi, trendlerin belirlenmesi ve gelecekteki olayların tahmin edilmesi için kullanılır. Sıralı dizilerin büyük veri içindeki önemi, veri analizi süreçlerinde kullanıcıların daha etkili kararlar almalarını sağlamalarıyla ortaya çıkmaktadır. Zaman serisi analizi, makine öğrenimi ve veri görselleştirme gibi alanlarda sıralı dizilerin kullanımı, işletmelerin stratejilerini güçlendirir. Ayrıca, veri temizleme süreçleri sıralı dizilerin güvenilirliğini artırarak, analiz sonuçlarının doğruluğunu sağlamaktadır. Gelecekte, yapay zeka ve makine öğrenimi teknolojilerinin entegrasyonu ile sıralı dizilerin önemi daha da artacak ve veri analitiği alanında yeniliklerin kapısını açacaktır.

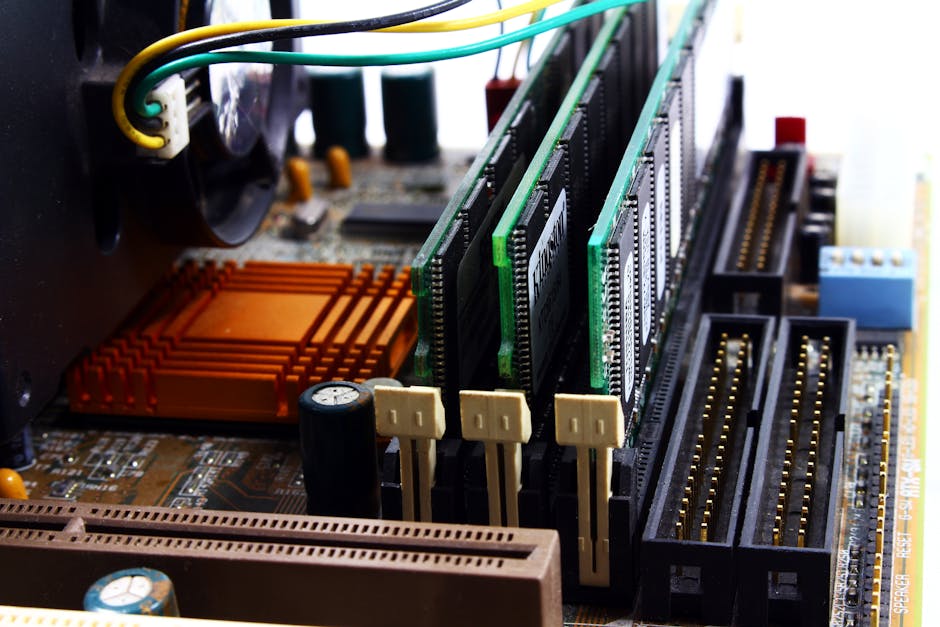

TensorFlow ile makine öğrenimi nasıl yapılır?

TensorFlow, Google tarafından geliştirilen açık kaynaklı bir makine öğrenimi kütüphanesidir. Derin öğrenme modelleri oluşturmak ve eğitmek için kullanılır ve kullanıcı dostu yapısı ile karmaşık hesaplamaları kolaylaştırır. Makine öğrenimi, gözetimli ve gözetimsiz öğrenme olmak üzere iki ana kategoriye ayrılmaktadır. TensorFlow, temel bileşenleri olan Tensor'lar, Graf'lar ve Oturumlar ile bu süreçleri kolaylaştırır. Veri seti hazırlama süreci, doğru verilerin toplanması, temizlenmesi ve düzenlenmesi ile başlar. Model oluşturma aşamasında uygun bir model tipi seçilir ve TensorFlow kullanılarak yapılandırılır. Model eğitimi, veriler üzerinde algoritmalarla optimizasyon yaparak gerçekleştirilir; kayıp fonksiyonları ve optimizasyon teknikleri ile desteklenir. Modelin değerlendirilmesi, temel göstergeler ve test setleri kullanılarak yapılır; çapraz doğrulama gibi yöntemlerle overfitting riski azaltılır. Modeli kaydetme işlemi, gelecekteki kullanımlar için önemlidir ve TensorFlow'un sağladığı fonksiyonlar ile basit bir şekilde yapılabilir. Uygulama örnekleri ile öğrenim süreci desteklenir ve ipuçları, doğru veri ön işleme ve hiperparametre optimizasyonu gibi unsurlar, başarılı bir proje geliştirmeye katkı sağlar. TensorFlow ile makine öğrenimi, sistematik bir çalışma ve doğru yöntemlerle gerçekleştirilebilir.

"Yapay zeka ile veri işleme nasıl yapılır?"

Yapay zeka, veri işleme süreçlerini köklü bir şekilde değiştiren bir teknolojidir. Verilerin toplanması, temizlenmesi ve düzenlenmesi ile başlayan veri işleme süreci, yapay zeka algoritmalarıyla daha ileri düzeyde analiz imkanı sunar. Gerçek zamanlı verilerle hızlı karar alma yeteneği kazandıran yapay zeka, kalıpların belirlenmesi ve anlamlandırma süreçlerini geliştirir. Veri setlerinin hazırlanması ve temizlenmesi, model eğitimi, hiperparametre optimizasyonu gibi adımlar, başarılı bir uygulama için kritik öneme sahiptir. İstatistik, makine öğrenimi ve derin öğrenme gibi çeşitli algoritmalar, veri işleme sürecinde kullanılırken, veri görselleştirme, sonuçların daha anlaşılır hale gelmesini sağlar. Performans değerlendirmesi ise, modelin doğruluğu, işlem hızı ve esnekliği gibi kriterlerle yapılmalıdır. Ayrıca, veri gizliliği ve etik konuları göz önünde bulundurulmalıdır. Gelecek trendleri, makine öğrenimi otomasyonu ve veri güvenliği üzerindeki odaklanmayı artırarak, yapay zekanın veri işleme süreçlerinde yenilikler getirecektir.

"Makine öğrenimi ile projeye nasıl başlanır?"

Makine öğrenimi, bilgisayar sistemlerinin verilerden öğrenme ve bu verileri analiz etme yeteneğini kazandıran bir teknolojidir. Projeye başlangıç için temel kavramların anlaşılması, yani denetimli, denetimsiz ve pekiştirmeli öğrenme türlerinin ile veri setlerinin öneminin kavranması gereklidir. Proje hedefleri net olarak belirlenmeli ve gereksinim duyulan verilerin toplanması ile hazırlanması aşamaları dikkatlice yürütülmelidir. Model seçimi doğru verilerin analizi ile yapılmalı ve ardından modelin eğitilmesi, değerlendirilmesi süreçleri titizlikle uygulanmalıdır. Elde edilen sonuçların yorumlanması ve raporlanması, proje paydaşlarına bilgi sunmak açısından büyük önem taşır. Son olarak, uygulama ve iyileştirme aşamaları ile etkili proje yönetimi ve takım çalışması, başarılı bir makine öğrenimi projesinin temel bileşenleridir. Gelecekte, makine öğrenimi ve yapay zekanın hızla gelişmesi, yeni fırsatlar ve iş dinamiklerini değiştirecektir.

"Data Science nedir ve nasıl başlanır?"

Data Science, verilerin toplanması, analizi ve yorumlanması süreçlerini kapsayan çok disiplinli bir alandır. Verilerin kalitesi ve güvenilirliği, sağlam sonuçlar elde etmenin anahtarıdır. Data Science, birçok sektörde etkin karar verme süreçlerine katkıda bulunarak stratejik planlamaların temelini oluşturur. Temel kavramlar arasında veri toplama, ön işleme, analiz, modelleme ve görselleştirme yer alır. Python ve R gibi programlama dilleri, istatistik ve olasılık teorileri ile birlikte, veri görselleştirme araçları, makine öğrenimi kütüphaneleri gibi çeşitli araçlar bu alanda sıkça kullanılmaktadır. Data Science süreçleri, veri toplama ile başlayıp, analiz ve sonuçların raporlanması ile devam eder. Veri analizi yöntemleri arasında istatistiksel analiz, makine öğrenimi ve veri madenciliği yer alırken, Data Scientist, Data Analyst ve Machine Learning Engineer gibi kariyer pozisyonları mevcut. Veri gizliliği ve etik konuları ise büyük önem taşımaktadır. Gelecekte, veri güvenliği, yapay zeka ve otomasyonun yükselişi, veri biliminin dinamiklerini etkileyecektir.

"OpenAI GPT-3 nasıl kullanılır?"

OpenAI GPT-3, metin yazma süreçlerini kolaylaştıran güçlü bir dil modelidir. Kullanırken etkili sonuçlar almak için açık ve net talimatlar vermek, kısa cümleler kullanmak, örnekler sunmak ve gerekli düzeltmeleri yapmak önemlidir. Farklı modlar denemek ve çıktıların uzunluk ve stil ayarlarını belirlemek, modelin yönlendirilmesine yardımcı olur. OpenAI GPT-3, geniş veri setiyle eğitildiği için esnek yanıtlar verebilir ancak güncel bilgilerde sınırlı kalabilir. Veriler üzerinde analiz yaparken GPT-3'ün dil anlama yeteneklerinden yararlanarak anlamlı sonuçlar elde edilebilir. ETKİLİ içerik üretimi için güvenilir bilgi kaynaklarına başvurmak, hedef kitleye uygun içerikler oluşturmak ve etik kurallara dikkat etmek gereklidir. GPT-3, yazılı iletişimi geliştirmek, SEO uyumlu içerik üretmek ve yaratıcılığı artırmak için de kullanılabilir. Ancak, kullanıcıların çıkan metinlerin doğruluğunu değerlendirmesi ve gerektiğinde düzenlemesi önemlidir. Böylece, GPT-3'ün sunduğu faydalardan en iyi şekilde yararlanmak mümkündür.